Sommario

I ricercatori della Tokyo University of Science hanno sviluppato un innovativo metodo di “Black-Box Forgetting” che consente di rimuovere selettivamente informazioni non necessarie dai modelli di intelligenza artificiale su larga scala, migliorando l’efficienza e affrontando questioni legate alla privacy. Questa metodologia, applicata a modelli come CLIP, potrebbe rivoluzionare l’utilizzo dell’AI, rendendola più sostenibile e specializzata.

Cos’è il Black-Box Forgetting?

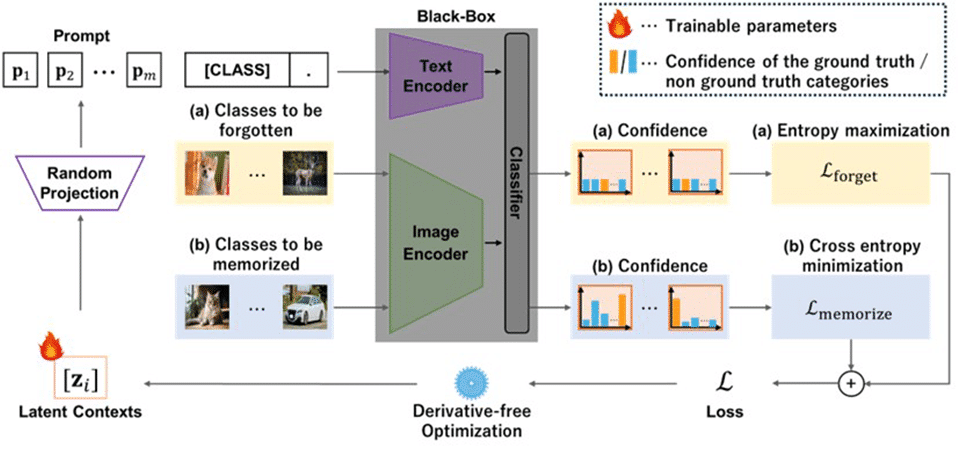

Il Black-Box Forgetting è un processo che permette ai modelli AI di “dimenticare” classi di oggetti inutili, mantenendo la capacità di riconoscere le categorie rilevanti. Ad esempio, in un sistema di guida autonoma, è fondamentale identificare veicoli, pedoni e segnali stradali, mentre categorie come cibo o mobili risultano superflue e possono ridurre la precisione del modello.

Questa tecnica si differenzia dai metodi tradizionali, poiché non richiede accesso ai parametri interni del modello (setting “white-box”). Utilizzando un’ottimizzazione priva di derivati, i ricercatori possono ottimizzare i prompt di input per influenzare il comportamento del modello, eliminando classi specifiche senza alterarne il funzionamento complessivo.

Innovazioni tecniche

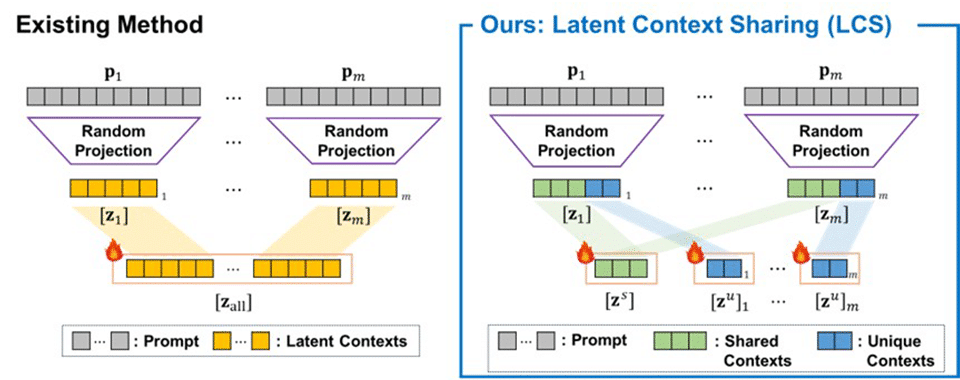

La sfida principale dell’approccio era ridurre la complessità computazionale. A questo scopo, il team ha sviluppato un metodo di “Latent Context Sharing”, che decomprime i contesti latenti in unità più piccole, uniche o condivise tra diversi token. Questo approccio ha reso il problema gestibile, ottimizzando i prompt senza compromettere le prestazioni del modello.

Test condotti su dataset di benchmark hanno dimostrato che il metodo può far “dimenticare” fino al 40% delle classi mantenendo alta precisione sulle categorie rimanenti.

Implicazioni pratiche e future

Le applicazioni del Black-Box Forgetting sono molteplici:

- Miglioramento delle performance: i modelli possono essere adattati per compiti specifici, evitando sprechi di risorse computazionali.

- Protezione della privacy: il metodo consente di rimuovere informazioni sensibili dai modelli senza doverli addestrare nuovamente, contribuendo a rispettare il “Diritto all’oblio”, particolarmente rilevante in settori come la sanità e la finanza.

- Prevenzione dei contenuti indesiderati: modelli di generazione di immagini possono essere programmati per evitare la creazione di contenuti non appropriati.

Il Black-Box Forgetting rappresenta un passo avanti significativo nella gestione dei modelli AI su larga scala, rendendoli più adattabili, efficienti e rispettosi delle esigenze etiche e legali. Con potenziali applicazioni che spaziano dalla personalizzazione dei sistemi all’incremento della sicurezza, questa metodologia segna una nuova era nell’evoluzione dell’intelligenza artificiale.