Sommario

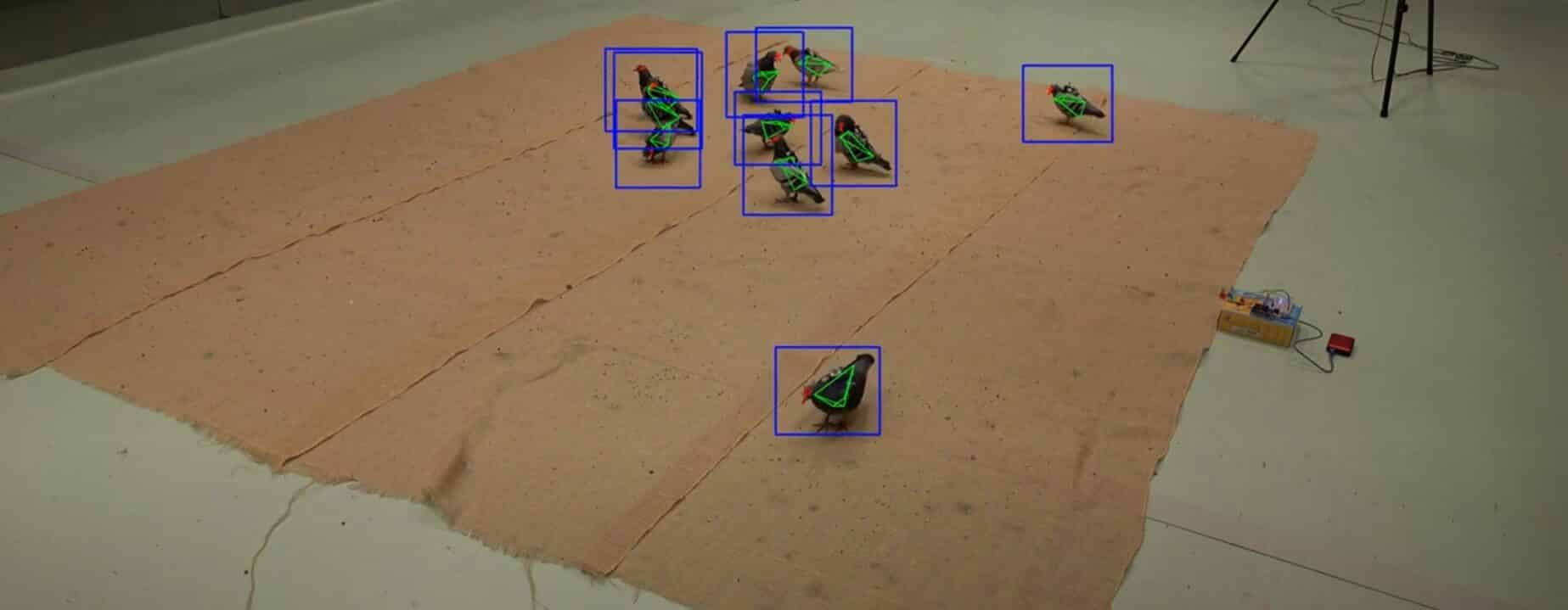

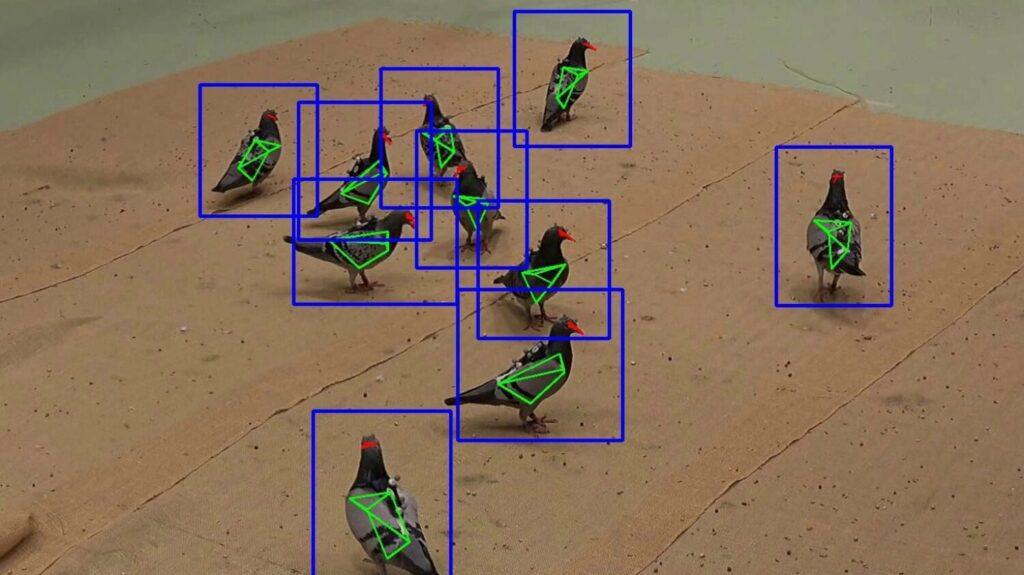

Due piccioni beccano dei semi in un parco di Konstanz. Un terzo piccione vola vicino. Attorno a loro, ci sono quattro telecamere. I dottorandi Alex Chan e Urs Waldmann del Cluster of Excellence Collective Behaviour dell’Università di Konstanz stanno filmando la scena. Dopo un’ora, tornano al loro ufficio per analizzare i filmati con un framework di visione artificiale per la stima della postura e il tracciamento dell’identità. Il framework rileva e disegna una casella intorno a tutti i piccioni, registrando le parti centrali del corpo, determinandone la postura, la posizione e l’interazione con gli altri piccioni. Tutto ciò avviene senza alcun marcatore attaccato agli animali e senza l’intervento umano, un’impresa impensabile solo pochi anni fa.

3D-MuPPET: Stima e Tracciamento della Postura 3D

Recentemente, i ricercatori del Cluster of Excellence Collective Behaviour dell’Università di Konstanz e del Max Planck Institute of Animal Behaviour hanno sviluppato 3D-MuPPET, un framework per la stima e il tracciamento delle pose 3D di fino a 10 piccioni utilizzando più visuali di telecamere. La pubblicazione correlata è stata recentemente pubblicata sull’International Journal of Computer Vision (IJCV) ed è parte di un numero speciale sull’uso della visione artificiale per il tracciamento e la modellazione degli animali.

3D-MuPPET si basa sul dataset 3D-POP e sul framework I-MuPPET, sviluppati dai ricercatori del Cluster of Excellence Collective Behaviour. Questo nuovo metodo rappresenta un importante traguardo nel tracciamento della postura animale e nell’analisi automatica del comportamento.

Tracciamento della Postura Animale in 3D

Il framework 3D-MuPPET permette la stima della postura e il tracciamento dell’identità di fino a 10 piccioni da quattro visuali di telecamere, basandosi su dati raccolti sia in ambienti controllati che in natura. “Abbiamo addestrato un rilevatore di punti chiave 2D e triangolato i punti in 3D, dimostrando che i modelli addestrati su dati di singoli piccioni funzionano bene anche con dati di gruppi di piccioni”, spiega Urs Waldmann. Questo è il primo esempio di tracciamento della postura 3D di un intero gruppo di fino a 10 individui.

Applicazioni Future e Potenziali

Oltre al tracciamento dei piccioni in ambienti chiusi, il framework è stato esteso anche ai piccioni in natura. Utilizzando un modello chiamato Segment Anything Model, i ricercatori hanno addestrato un rilevatore di punti chiave 2D con un piccione mascherato dai dati di cattività e poi applicato il modello ai video di piccioni all’aperto senza ulteriori adattamenti. 3D-MuPPET rappresenta uno dei primi casi di studio su come passare dal tracciamento degli animali in cattività al tracciamento degli animali in natura, permettendo di misurare i comportamenti fini degli animali nei loro habitat naturali. Le metodologie sviluppate possono essere potenzialmente applicate anche ad altre specie, con applicazioni future nella ricerca sul comportamento collettivo e nel monitoraggio delle specie in modo non invasivo.

3D-MuPPET dimostra essere un framework potente e flessibile per i ricercatori che desiderano utilizzare la ricostruzione della postura 3D per studiare il comportamento collettivo in qualsiasi ambiente o specie. Finché è disponibile un setup multi-camera e un rilevatore di postura 2D, il framework può essere applicato per tracciare le posture 3D di qualsiasi animale.